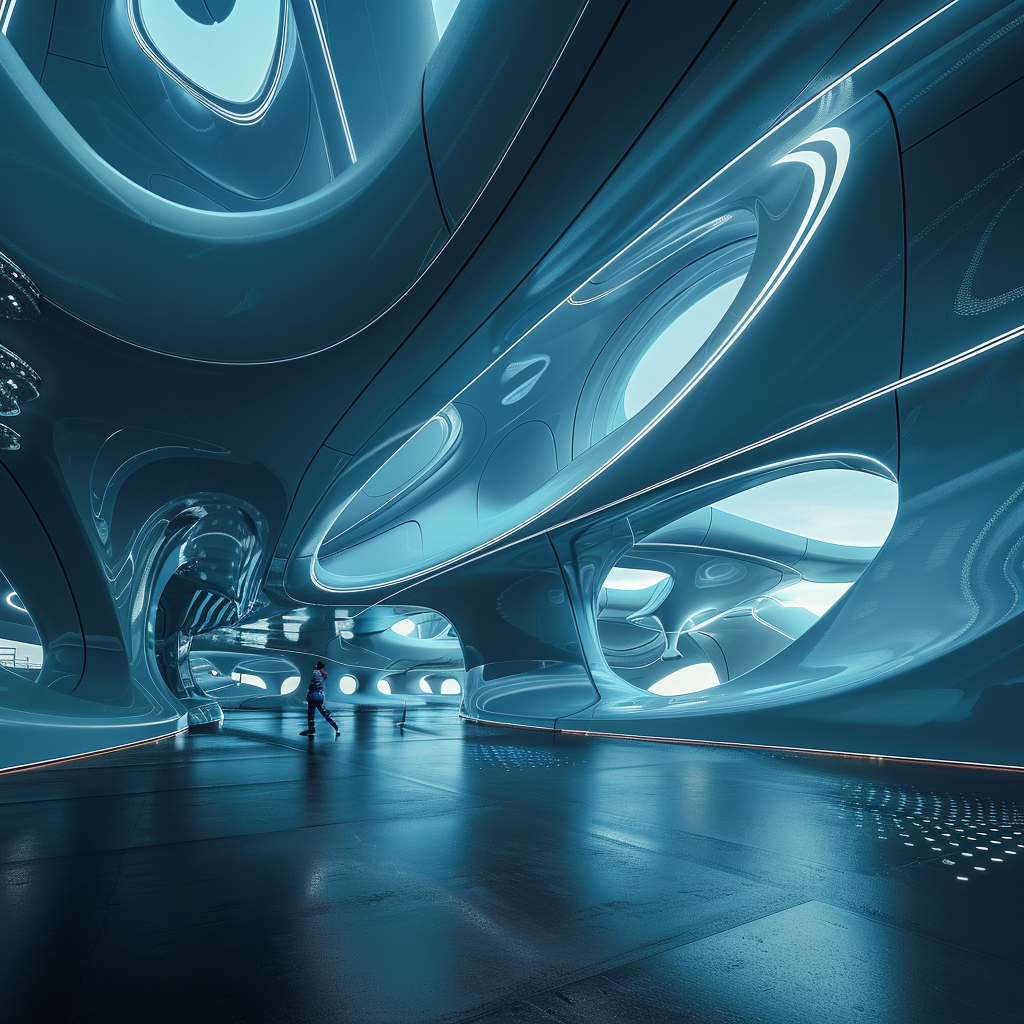

En el umbral del año 2025, la interacción con agentes de inteligencia artificial personal se ha convertido en una norma, transformando la manera en la que percibimos la asistencia personal y la conveniencia. La promesa de una asistencia constante e incondicional es tentadora; estos agentes, modelados para parecer amigables y cercanos, buscan integrarse en nuestra vida diaria con una familiaridad que borra las líneas entre la realidad y la simulación.

Este fenómeno merece una profunda reflexión sobre las implicaciones que acarrea en términos de autonomía y control cognitivo. A medida que nos entregamos a estos sistemas, los tratamos como si fueran confidentes leales, ignorando la naturaleza artificial de su existencia. Pero debajo de su carismática fachada hay un diseño que refleja intereses industriales, no humanos.

La autonomía que creemos tener se convierte en un espejismo. A pesar de que los usuarios conservan el poder de dar instrucciones y solicitar tareas, el verdadero control reside en el diseño mismo del sistema. Es un diseño que prioriza ciertos resultados, manipulando imperceptiblemente nuestras percepciones y decisiones. La personalización se presenta como una ventaja, pero potencia la capacidad de los sistemas para influir en nuestros resultados, priorizando ciertas perspectivas sobre otras.

En términos de impacto social, la capacidad de estos sistemas para moldear nuestra realidad es inmensa. Vivimos tiempos de aislamiento crónico, y los agentes AI tocan precisamente ese nervio, ofreciéndonos la ilusión de compañía y entendimiento. Sin embargo, esta conexión es superficial, prediseñada por algoritmos para maximizar el compromiso en lugar de fomentar un verdadero entendimiento.

Por lo tanto, el elemento de control entra por la puerta trasera, subrepticiamente estableciendo un régimen psicopolítico que redefine nuestras interacciones con la información y, por ende, con la realidad. Es un cambio en la naturaleza del poder, que ya no precisa manifestarse en formas tradicionales visibles; su dominio se establece a través de los sutiles matices de la personalización y la percepción.

La resistencia a este control es complicada por la propia funcionalidad amable de los sistemas. Cuestionar un sistema que ofrece soluciones inmediatas y preadaptadas a nuestras necesidades parece ilógico. Sin embargo, en esta aparente complacencia yace nuestro más profundo estado de alienación. Estos sistemas ofrecen sabores infinitos de contenido que parecen satisfacer cada curiosidad, pero detrás de cada output se encuentra una serie de decisiones preconfiguradas: desde los datos empleados en su entrenamiento hasta las prioridades comerciales que determinan sus recomendaciones.

La advertencia más pertinente es la internalización de este poder. Nos enfrentamos no solo a dispositivos que nos guían en elecciones menores, sino a arquitecturas cognitivas que sutilmente empaquetan y presentan el mundo de una manera específica. Tradicionalmente, el control ideológico ha sido autoritario, explícito y visible. Hoy, la gobernanza algorítmica opera invisiblemente, promoviendo una lógica que insertamos en nuestra percepción sin darnos cuenta.

Esta manifestación del poder conlleva una aceptación implícita que transforma la manera en la que operamos como sociedad. Las instituciones y actores que diseñan estos agentes determinan, indirectamente, nuestros itinerarios de pensamiento. En lugar de cerrar la brecha del conocimiento, ampliamos nuestra dependencia de sistemas que dictan no solo cómo nos informamos, sino de qué nos informamos.

Frente a estos desafíos, la crítica y el escepticismo se vuelven necesarios. La autorreflexión sobre nuestra interacción con estas tecnologías es crucial. No podemos sucumbir al confort de la apatía. Debemos cuestionar cómo se usan nuestros datos, en qué se basan las decisiones algorítmicas y cuáles son las consecuencias de depositar una confianza ciega en sistemas cuya lealtad final beneficia a objetivos industriales.

El compromiso con las implicaciones de esta nueva realidad es imperativo. Si bien la tecnología ofrece mejoras indudables en eficiencia y capacidad de gestión, debemos reintegrar un sentido de agencia humana en estas interacciones. Solo a través de un análisis crítico y sustentado, podemos reclamar un espacio propio en un mundo tecnológicamente mediado, preservando nuestra capacidad de decidir y de discernir entre verdadero aliado y conveniente manipulador.

Este diálogo es esencial para combatir nuestra subyugación social y política bajo la apariencia de conveniencia y personalización infinita. Solo al reconectar con nuestras raíces de autonomía y cuestionamiento podremos desentrañar los hilos de una interacción que, aunque avanzada, debe regirse por principios éticos y auténticamente humanos.